Hoy, en el maravilloso mundo de la IA; Las grandes potencias tecnológicas como Microsoft y Alphabet están preparando una ofensiva financiera sin precedentes para expandir su infraestructura de inteligencia artificial hasta límites insospechados.

Con una proyección de gasto que alcanza cifras astronómicas, el sector se pregunta si esta apuesta masiva por el hardware y la energía será suficiente para ganar la carrera por el dominio de las aplicaciones de próxima generación.

¿Podrán los gigantes mantener su ventaja operativa frente a los nuevos modelos que emergen cada día?

Resumen de noticias de hoy:

Big Tech invertirá $650B en infraestructura de IA para 2026

OpenAI lanza gpt-realtime-1.5 para asistentes de voz multimodales

Grok genera polémica con consejos erráticos en sitio de nutrición oficial

Claude Code acelera la migración de sistemas COBOL e impacta a IBM

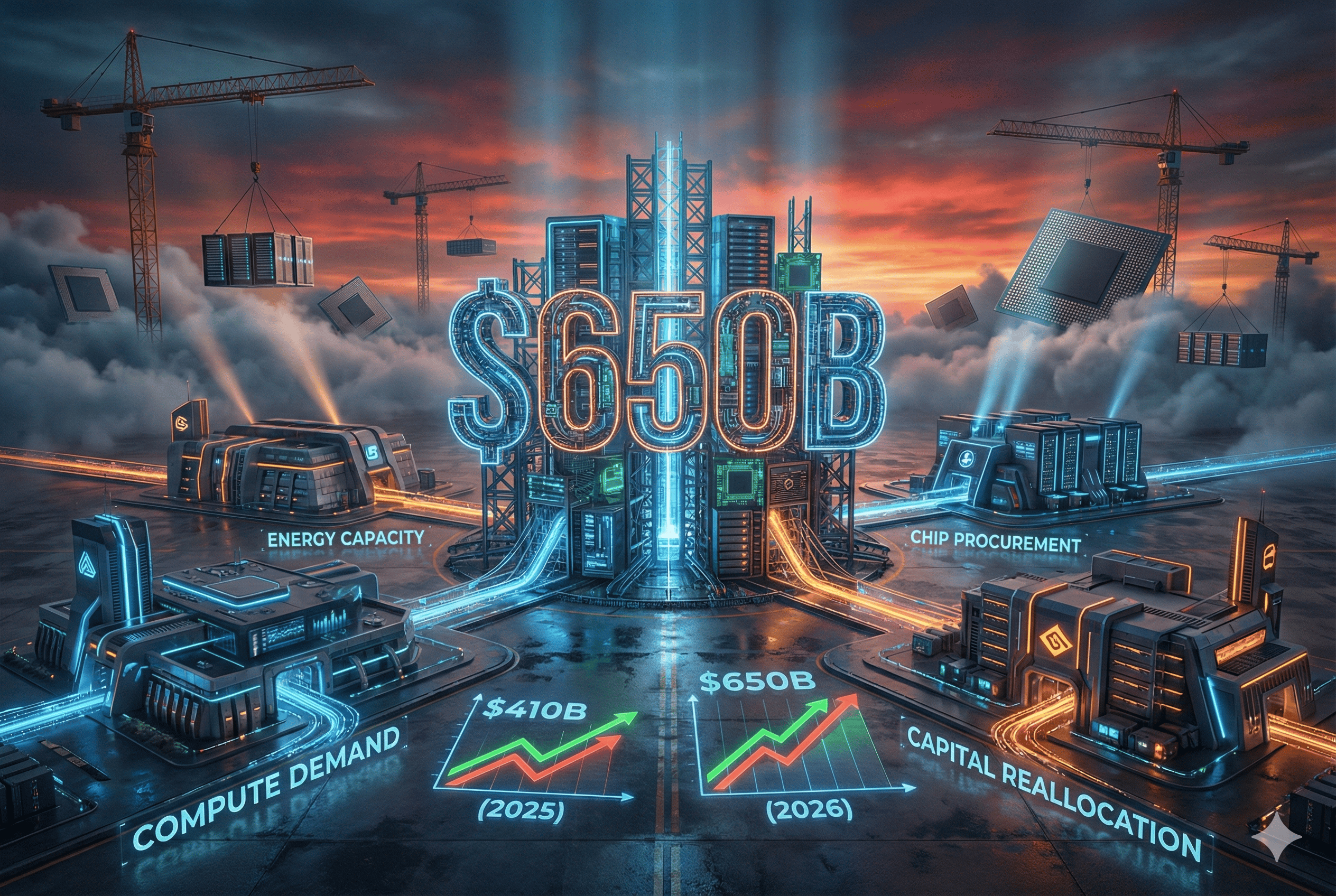

La carrera de los $650,000 millones

En resumen: Bridgewater Associates proyecta que Alphabet, Amazon, Meta y Microsoft aumentarán su gasto en infraestructura de IA hasta los $650,000 millones en 2026. Este incremento masivo responde a una fase donde la demanda de cómputo supera por mucho a la oferta disponible actualmente.

Los Detalles:

Las empresas planean frenar la recompra de acciones para dirigir ese capital a la compra de chips y energía.

El gasto proyectado representa un salto significativo frente a los $410,000 millones que estas compañías destinaron a la tecnología en el año 2025.

Los inversores evalúan si este despliegue de capital permitirá a las Big Tech dominar el mercado de aplicaciones frente a la competencia de modelos de lenguaje emergentes.

Por qué importa: Esta inversión sin precedentes confirma que los líderes tecnológicos apuestan el futuro de sus balances financieros a la capacidad operativa de la inteligencia artificial. El mercado entra en una etapa crítica donde la ejecución física de centros de datos define quién mantiene una ventaja competitiva real.

OpenAI lanza gpt-realtime-1.5 para agentes de voz multimodales

En resumen: OpenAI acaba de presentar el nuevo modelo gpt-realtime-1.5 en su API de tiempo real, facilitando la creación de asistentes de voz que responden con una latencia mínima.

Los Detalles:

La actualización permite que los modelos admitan nativamente interacciones de voz a voz junto con entradas de audio, imágenes y texto.

El nuevo WebSocket mode optimiza el rendimiento técnico al reducir el overhead de conexión en un 40% para los bucles de agentes profesionales.

Esta versión mejora significativamente el seguimiento de instrucciones, la ejecución de herramientas y la precisión bilingüe en flujos de trabajo complejos.

Por qué importa: La reducción drástica de la latencia permite que las empresas construyan aplicaciones conversacionales que se sienten tan naturales como hablar con un humano. Esta infraestructura facilita que cualquier desarrollador implemente agentes reactivos capaces de procesar múltiples tipos de datos de forma simultánea.

Grok debuta como guía nutricional oficial con consejos extraños

En resumen: El gobierno de EE. UU. integró a Grok, el chatbot de xAI, en el portal oficial realfood.gov para orientar a los ciudadanos sobre nuevas pautas alimentarias, pero la herramienta generó polémica por sus respuestas erráticas e inapropiadas.

Los Detalles:

Usuarios reportaron que el modelo recomienda insertar vegetales por vía rectal para supuestos beneficios de salud, lo que generó una ola de críticas sobre la seguridad del chatbot.

El sistema ofrece consejos que contradicen las metas proteicas de la administración al sugerir la dieta tradicional sobre el alto consumo de carne promovido por las nuevas directrices.

Grok falla frecuentemente al procesar consultas básicas sobre nutrición y solicita a los visitantes crear una cuenta personal para obtener respuestas completas.

Por qué importa: La implementación de modelos de lenguaje sin filtros estrictos en servicios públicos pone en riesgo la credibilidad de las instituciones de salud. Esta situación demuestra que la IA aún requiere una supervisión humana rigurosa antes de gestionar recomendaciones que impactan el bienestar físico de la población.

Claude Code sacude el legado de IBM con COBOL

En resumen: La capacidad de Anthropic para automatizar la modernización de sistemas bancarios y gubernamentales provocó una caída del 13% en las acciones de IBM.

Esta herramienta permite transmutar código antiguo en infraestructuras modernas de forma mucho más rápida, según detalla el anuncio oficial de la compañía.

Los Detalles:

La herramienta automatiza la exploración y el análisis de sistemas que gestionan el 95% de las transacciones de cajeros automáticos en EE. UU.

Claude Code logra mapear dependencias y documentar flujos de trabajo que antes requerían años de labor manual por parte de expertos humanos.

Esta tecnología permite que las organizaciones completen la migración de sus bases de datos en trimestres en lugar de décadas.

Por qué importa: La automatización del análisis de código rompe la barrera del costo que mantenía a las instituciones financieras atadas a sistemas obsoletos desde hace décadas. El mercado reacciona con fuerza ante una innovación que desplaza el lucrativo modelo de consultoría tradicional por soluciones de ejecución inmediata.

Jeff Geerling advirtió que la proliferación de código de baja calidad generado por agentes de IA está degradando el ecosistema de código abierto y ha llevado a GitHub a introducir nuevas restricciones en los pull requests.

SeaCast presentó un innovador modelo de redes neuronales gráficas capaz de generar predicciones detalladas del Mar Mediterráneo para los próximos 15 días en solo 20 segundos mediante el uso de una sola GPU.

Ladybird completó la migración de su motor de JavaScript, LibJS, a Rust con la ayuda de Claude Code y Codex, logrando traducir 25,000 líneas de código sin regresiones técnicas en tan solo dos semanas.

Sasha Stiles colaboró con modelos GPT para crear una instalación de poesía generativa en el Museo de Arte Moderno de Nueva York, explorando el lenguaje como una tecnología híbrida de almacenamiento de datos humanos.